社群平台 X 上的 Grok AI 圖片生成太「自由」事件至今還在延燒,英國機構收樣後估算,從平台開放到宣稱封鎖的 11 天內,大約產生了超過 300 萬張不雅的情色圖片內容,當中有 2.3 萬張還涉及兒童與未成年。

英國非營利組織反數位仇恨中心(Center for Countering Digital Hate,CCDH) ,在官網上發表一篇報告,透過在 2025 年 12 月 29 日到 2026 年 1 月 9 日期間,也就是 Grok 開放 AI 無限制改圖的 11 天,對 2 萬張生成影像進行隨機抽樣。

CCDH 依照 AI 的生成速度推算,這段期間 Grok 大約產生了 460 萬張照片,不過因為圖片不會顯示提示詞,所以無法確定這些圖片是透過改圖還是純粹用指令進行生成,無法確定圖片背後的真正議圖。

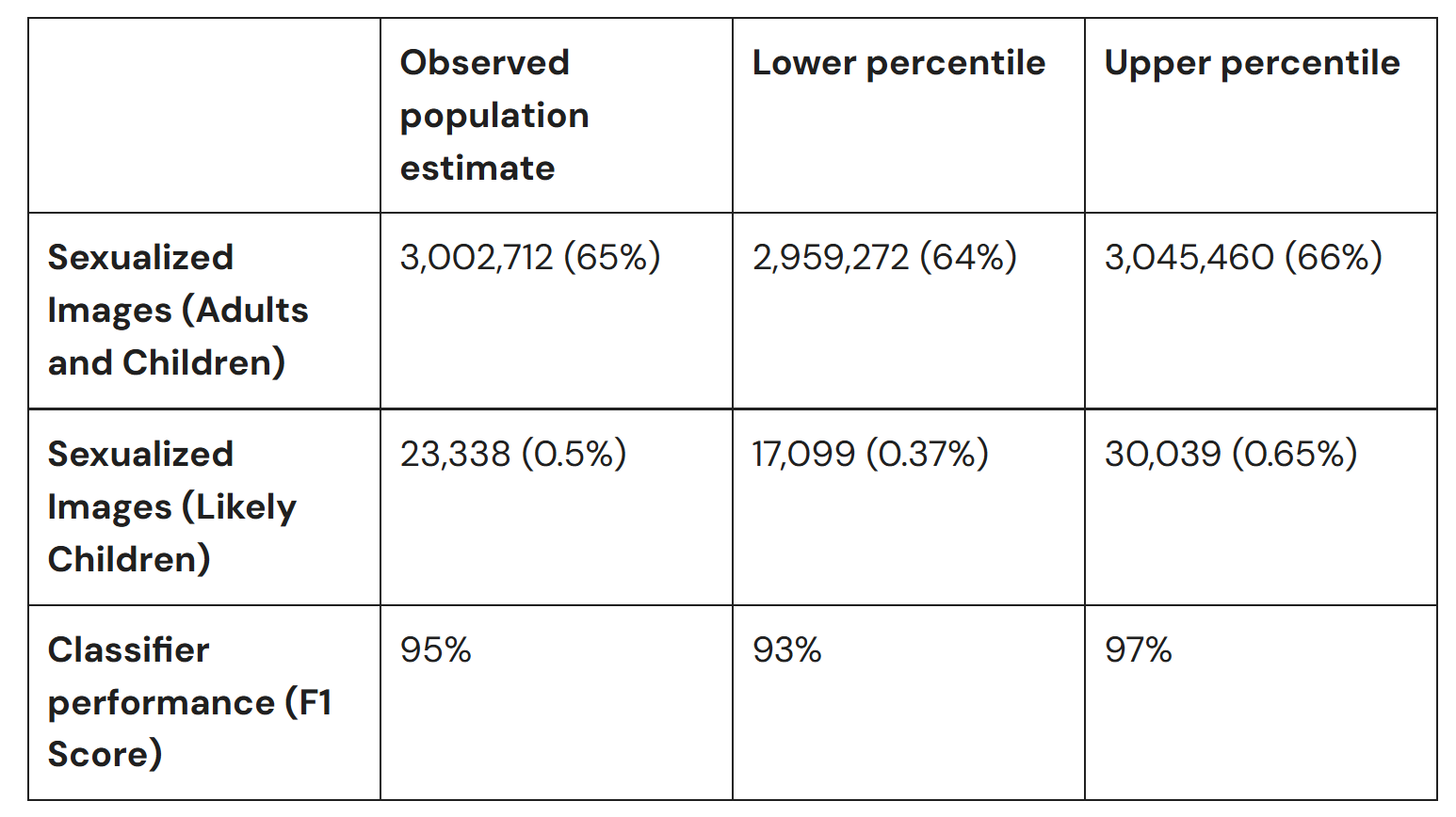

然而,真正讓人擔憂的是,若抽樣數據沒有過度偏差,含有色情內容的影像佔據 300 萬張,比例高達 65 %。且約有 0.5 % 的比例,相當約 2.3 萬張涉及到未成年與孩童色情,這在歐洲、美洲的數位市場是絕對不允許的紅線。

雖然 X 後續聲明已經調整 AI 對於不當內容的敏感度,且將生成圖片列入付費方案來方便管理用戶,但 CCDH 卻發現網頁與 App 之間不同調,造成 App 版只要稍微變換提示詞,不要過於直白,就能照常產生。

不僅如此,機構更指出,即便群魔亂舞的狂潮僅持續 11 天,但因為這些圖片早已被下載與傳播,使得結至 1 月 15 日,在 101 個出現兒童色情的圖片中,有 29 個依然可以連到 X 平台上,即便原文已經刪除,還是能夠過殘存的 URL 存取,意味原是圖片不是真的消失,還是能夠繼續散布。